統(tǒng)一的文本到結(jié)構(gòu)生成框架——UIE

眾所周知,信息抽?。↖E)是一個(gè)從文本到結(jié)構(gòu)的轉(zhuǎn)換過(guò)程。常見(jiàn)的實(shí)體、關(guān)系、事件分別采取Span、Tr....

基于GPT-2進(jìn)行文本生成

文本生成是自然語(yǔ)言處理中一個(gè)重要的研究領(lǐng)域,具有廣闊的應(yīng)用前景。國(guó)內(nèi)外已經(jīng)有諸如Automated ....

領(lǐng)域遷移一種簡(jiǎn)單而有效的方法Alter

如圖2所示,Transformer模型一般由輸入嵌入層、輸出層和若干結(jié)構(gòu)相同的Transformer....

遷移學(xué)習(xí)Finetune的四種類型招式

遷移學(xué)習(xí)廣泛地應(yīng)用于NLP、CV等各種領(lǐng)域,通過(guò)在源域數(shù)據(jù)上學(xué)習(xí)知識(shí),再遷移到下游其他目標(biāo)任務(wù)上,提....

視覺(jué)語(yǔ)言預(yù)訓(xùn)練(VLP)模型的最新進(jìn)展

讓機(jī)器做出與人類相似的反應(yīng)一直是 AI 研究不懈追求的目標(biāo)。為了讓機(jī)器具有感知和思考的能力,研究人員....

一文詳解知識(shí)增強(qiáng)的語(yǔ)言預(yù)訓(xùn)練模型

隨著預(yù)訓(xùn)練語(yǔ)言模型(PLMs)的不斷發(fā)展,各種NLP任務(wù)設(shè)置上都取得了不俗的性能。盡管PLMs可以從....

Transformers研究方向

要說(shuō) BERT 為什么性能卓越,主要是它改變了 NLP 模型的訓(xùn)練方式。先在大規(guī)模語(yǔ)料上訓(xùn)練出一個(gè)語(yǔ)....

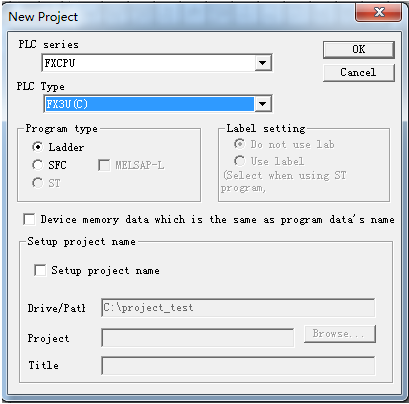

三菱PLC和WinCC如何實(shí)現(xiàn)OPC通訊

添加后的變量在圖中左側(cè)opc欄中,激活wincc運(yùn)行以后可以看到連接狀態(tài)正常,在右側(cè)值一欄數(shù)據(jù)讀取也....

cosFormer:重新思考注意力機(jī)制中的Softmax

商湯多模態(tài)研究組認(rèn)為,近似操作本身存在的誤差使得其效果很難超越Softmax Attention。我....

論辯挖掘在不同領(lǐng)域下的應(yīng)用

論辯研究和推理是一個(gè)涉及到邏輯、語(yǔ)言、計(jì)算機(jī)等多學(xué)科領(lǐng)域的過(guò)程,在人工智能興起的時(shí)代,計(jì)算論辯試圖將....

文本糾錯(cuò)是自然語(yǔ)言處理的第一道坎

對(duì)于政務(wù)公文、新聞出版等行業(yè)來(lái)說(shuō),一款針對(duì)以中文為母語(yǔ)的用戶所使用的校對(duì)系統(tǒng)將會(huì)有更大的幫助。因此,....

基于神經(jīng)轉(zhuǎn)移模型的論辯挖掘任務(wù)

論文提出了一種針對(duì)論辯挖掘任務(wù)的新方法,該方法通過(guò)產(chǎn)生一系列的動(dòng)作來(lái)逐步構(gòu)建出一個(gè)論證圖,從而有效地....

命名實(shí)體識(shí)別實(shí)踐 - CRF

CRF,英文全稱為Conditional Random Field, 中文名為條件隨機(jī)場(chǎng),是給定一組....

命名實(shí)體識(shí)別實(shí)踐 - CRF

CRF,英文全稱為Conditional Random Field, 中文名為條件隨機(jī)場(chǎng),是給定一組....

一種全新易用的基于Word-Word關(guān)系的NER統(tǒng)一模型

最近的研究都在考慮如何通過(guò)一個(gè)大一統(tǒng)模型一次性解決這三種問(wèn)題。目前的最佳的方法基本都是基于span-....

萬(wàn)能的prompt還能做可控文本生成

隨著 Prompting 技術(shù)的大火,我們一直在思考,Prompt 究竟能夠帶來(lái)什么?我們都說(shuō),Pr....

帶你從頭構(gòu)建文本分類器

文本分類是 NLP 中最常見(jiàn)的任務(wù)之一, 它可用于廣泛的應(yīng)用或者開(kāi)發(fā)成程序,例如將用戶反饋文本標(biāo)記為....

Propt learnimng是如何發(fā)展形成的

Prompt learning作為近期NLP的新寵,熱度不斷攀升,在接下來(lái)的一段日子,大概率還是會(huì)處....

如何實(shí)現(xiàn)更綠色、經(jīng)濟(jì)的NLP預(yù)訓(xùn)練模型遷移

NLP中,預(yù)訓(xùn)練大模型Finetune是一種非常常見(jiàn)的解決問(wèn)題的范式。利用在海量文本上預(yù)訓(xùn)練得到的B....

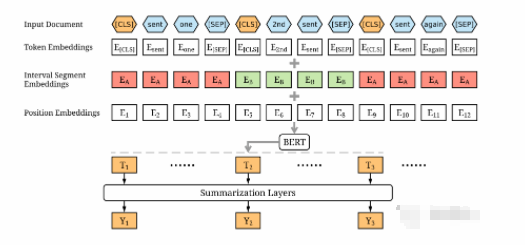

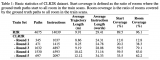

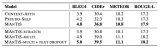

如何使用BERT模型進(jìn)行抽取式摘要

最近在梳理文本摘要相關(guān)內(nèi)容,翻到一篇19年關(guān)于基于BERT模型進(jìn)行抽取式摘要的老文「BertSu....

對(duì)比學(xué)習(xí)的關(guān)鍵技術(shù)和基本應(yīng)用分析

對(duì)比學(xué)習(xí)的主要思想是相似的樣本的表示相近,而不相似的遠(yuǎn)離。對(duì)比學(xué)習(xí)可以應(yīng)用于監(jiān)督和無(wú)監(jiān)督的場(chǎng)景下,并....

當(dāng)“大”模型遇上“小”數(shù)據(jù)

“ 或許自上次N篇ACL事件后,不少人會(huì)突然發(fā)現(xiàn)我銷聲匿跡了。的確,我20年論文斷供整整一年。這一年....

在不更改模型結(jié)構(gòu)和不修改數(shù)據(jù)的情況下提升智能體

2018 年 Anderson 等人提出了視覺(jué)語(yǔ)言導(dǎo)航(Vision-and-Language Na....

如何改進(jìn)雙塔模型才能更好的提升你的算法效果

來(lái)自:對(duì)白的算法屋 今天寫(xiě)點(diǎn)技術(shù)干貨來(lái)回饋一下我的粉絲們。本來(lái)想繼續(xù)寫(xiě)對(duì)比學(xué)習(xí)(Contrastiv....

如何使用多模態(tài)信息做prompt

自多模態(tài)大火以來(lái),井噴式地出現(xiàn)了許多工作,通過(guò)改造預(yù)訓(xùn)練語(yǔ)言模型,用圖像信息來(lái)增強(qiáng)語(yǔ)義信息,但主要集....

ACL2021的跨視覺(jué)語(yǔ)言模態(tài)論文之跨視覺(jué)語(yǔ)言模態(tài)任務(wù)與方法

來(lái)自:復(fù)旦DISC 引言 本次分享我們將介紹三篇來(lái)自ACL2021的跨視覺(jué)語(yǔ)言模態(tài)的論文。這三篇文章....

受控文本生成模型的一般架構(gòu)及故事生成任務(wù)等方面的具體應(yīng)用

來(lái)自:哈工大訊飛聯(lián)合實(shí)驗(yàn)室 本期導(dǎo)讀:本文是對(duì)受控文本生成任務(wù)的一個(gè)簡(jiǎn)單的介紹。首先,本文介紹了受控....

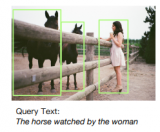

基于預(yù)訓(xùn)練視覺(jué)-語(yǔ)言模型的跨模態(tài)Prompt-Tuning

論文:CPT:Colorful Prompt Tuning for Pre-Training Vis....

關(guān)于PaddleNLP你了解多少

作者:劉健健 來(lái)自:ChallengeHub Twitter 的推文有許多特點(diǎn),首先,與 Faceb....

解讀數(shù)據(jù)挖掘在智慧醫(yī)療領(lǐng)域的應(yīng)用

本項(xiàng)目是通過(guò)學(xué)習(xí)機(jī)器學(xué)習(xí)與人工智能、數(shù)據(jù)挖掘的理論知識(shí),將理論運(yùn)用于智慧醫(yī)療等應(yīng)用探索中,從而產(chǎn)出高....